一、什么是残差连接

残差连接(Residual Connections)是一种广泛应用于深度学习中的关键技术,最初由何凯明等人在2015年的论文《Deep Residual Learning for Image Recognition》中提出,并应用于ResNet(Residual Network)中,极大地推动了深度神经网络的发展,尤其是在图像识别任务上的突破。

残差连接的心思想是通过引入“捷径”或“跳过连接”,将输入信号直接传递到网络的较深层,而不仅仅依赖于逐层前向传播的计算结果,从而改善深层网络的训练效果。

具体实现上,某个层的输入不仅经过一系列的非线性变换(如卷积、ReLU激活等),其原始输入还会绕过这一系列变换,然后与变换后的输出相加。数学上可以表示为 H(x) = F(x, W) + x,其中 x 是输入,F(x, W)是包含一组可学习参数W的一系列层的组合,H(x)是最终输出,即网络要学习的是残差映射而不是原始的全映射。

这种结构有助于解决神经网络随着层数的增多变得难以训练的问题,主要是出现梯度消失,梯度爆炸和网络退化的情况。因为在反向传播过程中,梯度可以通过捷径直接回传到浅层,无需经过所有层级的非线性激活函数的连续链式法则,从而缓解梯度消失或梯度爆炸的风险,使得优化更加稳定,进而允许构建和训练出更深层次的神经网络。此外,残差连接还有助于特征重用,增强浅层特征在网络较深层级的重要性,从而提升模型的学习能力和泛化能力。

二、残差链接的核心设计

典型残差块由卷积层(或全连接层)、激活函数(如ReLU)和跳跃连接组成。输入通过主路径处理后,与原始输入直接相加形成最终输出。

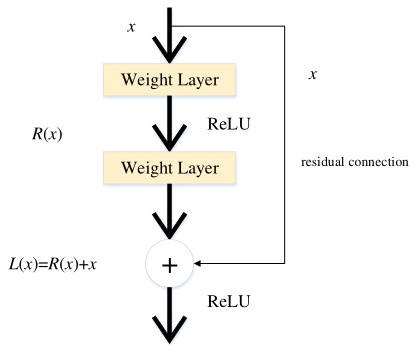

一个残差单元的结构如下:

其中:

- x:输入;

- Weight Layer:代表卷积层,这里是指Convolution卷积层 + Batch Normalization批量归一化层;

- ReLU:激活函数;

- L(x)=R(x)+x:表示将输入x经过变换后与卷积层的输出结果相加。

三、核心作用

- 缓解梯度消失/爆炸:深层网络中梯度反向传播时易衰减或爆炸,残差连接的跳跃路径为梯度提供了“高速公路”,确保梯度能有效传递至浅层。

- 促进恒等映射学习:即使主路径的权重更新不理想,跳跃连接仍能保留原始输入信息,避免网络性能退化。

- 提升训练稳定性:残差连接的加法操作具有自稳定效应,使参数更新幅度更平缓,降低训练震荡。

参考资料1:深度学习相关概念整理_残差连接-CSDN博客

参考资料2:残差连接(Residual Connections)_网络_训练_输出

参考资料3:Transformer系列:残差连接原理详细解析和代码论证_51CTO博客_残差连接 lstm 代码

参考资料4:【神经网络】(10) Resnet18、34 残差网络复现,附python完整代码_weight layer-CSDN博客